Cách chọn GPU xử lý ngôn ngữ tự nhiên toàn tập cho mọi đối tượng

GPU là yếu tố không thể thiếu để xử lý các mô hình ngôn ngữ tự nhiên hiện đại, đặc biệt với kiến trúc Transformer như GPT, BERT, T5. Các mô hình này yêu cầu thực hiện hàng tỷ phép toán ma trận, điều mà CPU truyền thống không thể đáp ứng hiệu quả.

So với các thế hệ trước, mô hình NLP hiện đại có số lượng tham số và lớp mạng thần kinh tăng gấp hàng trăm lần, đòi hỏi sức mạnh tính toán song song cực lớn. GPU với hàng nghìn lõi xử lý nhỏ, cho phép thực hiện đồng thời nhiều phép toán, giúp rút ngắn thời gian huấn luyện từ hàng tuần xuống chỉ còn vài ngày hoặc thậm chí vài giờ. Điều này tạo ra sự khác biệt lớn cho cả nghiên cứu lẫn triển khai thực tế.

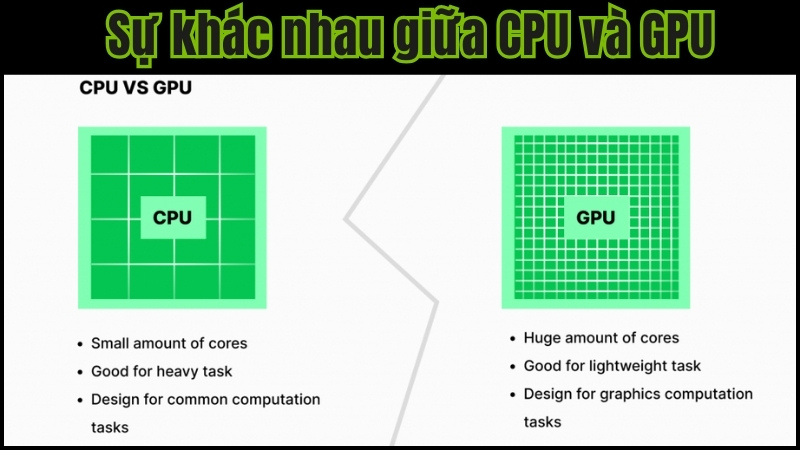

GPU vượt trội hơn CPU ở khả năng xử lý song song. Trong khi CPU chỉ có vài lõi mạnh, GPU có hàng nghìn lõi nhỏ, tối ưu cho các phép toán ma trận lớn của deep learning. Các thế hệ GPU mới như NVIDIA RTX 50 series hay A100/H100 còn tích hợp Tensor Cores, tăng tốc mạnh mẽ các tác vụ AI so với các dòng GPU cũ hoặc CPU truyền thống.

Điều này giúp GPU trở thành lựa chọn số 1 cho các dự án xử lý ngôn ngữ tự nhiên quy mô lớn.

GPU và CPU khác nhau thế nào trong NLP

Chọn GPU phù hợp không chỉ dựa vào giá tiền mà còn phải cân nhắc sâu về thông số kỹ thuật, hệ sinh thái phần mềm và khả năng mở rộng. Dưới đây là các tiêu chí then chốt bạn cần biết.

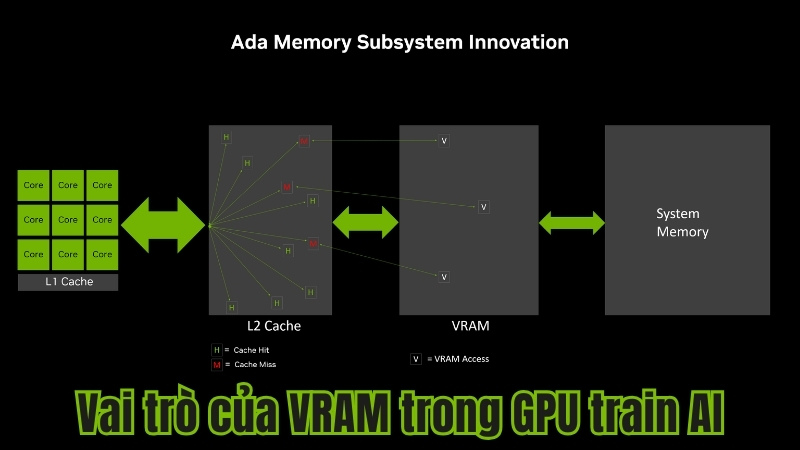

VRAM là bộ nhớ tốc độ cao tích hợp trên GPU, dùng để lưu trọng số mô hình, dữ liệu đầu vào và giá trị gradient trong quá trình huấn luyện. Nếu VRAM không đủ, bạn sẽ gặp lỗi "out of memory" và phải giảm batch size, ảnh hưởng đến tốc độ hội tụ và hiệu suất mô hình.

Vai trò của VRAM (Bộ nhớ GPU)

So với các dòng GPU cũ (ví dụ GTX 1080 Ti chỉ có 11GB VRAM), các GPU mới như RTX 5090 (36GB) hay A6000 (48GB) cho phép xử lý mô hình lớn như Llama 13B, Mistral 7B mà không gặp trở ngại về bộ nhớ.

|

Mô hình NLP tiêu biểu |

Số tham số (billion) |

VRAM tối thiểu khuyến nghị (GB) |

|---|---|---|

|

BERT Base |

0.11 |

8 |

|

GPT-2 Large |

0.77 |

12 |

|

Llama 7B |

7 |

16-24 |

|

Llama 13B |

13 |

24-40 |

|

GPT-3 |

175 |

>80 (đa GPU) |

Nhận xét: VRAM càng lớn, bạn càng dễ làm việc với mô hình lớn, batch size lớn, tăng tốc hội tụ và hiệu suất.

Tensor Cores là lõi xử lý chuyên dụng trên GPU NVIDIA từ Volta trở đi, tối ưu cho phép toán ma trận ở độ chính xác FP16/TF32. Khi huấn luyện mô hình ở chế độ mixed-precision (kết hợp FP16 và FP32), Tensor Cores giúp tăng tốc gấp 2-10 lần so với GPU không có tính năng này.

So với các dòng GPU trước đây (GTX series, không có Tensor Cores), các dòng RTX, A100, H100 đều hỗ trợ Tensor Cores, là lựa chọn ưu tiên cho NLP.

Băng thông bộ nhớ (GB/s) càng cao, GPU càng nhanh truy xuất dữ liệu từ VRAM tới lõi xử lý, giảm nghẽn cổ chai. Các GPU cao cấp như A100, H100 sử dụng bộ nhớ HBM2e siêu nhanh, vượt xa GDDR6X của dòng tiêu dùng.

Ví dụ:

Nhận xét: Băng thông cao cực kỳ quan trọng khi xử lý mô hình lớn, batch size lớn.

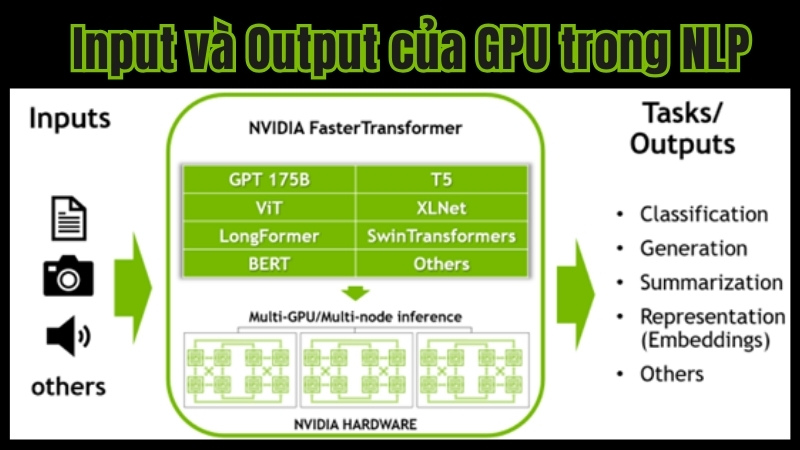

GPU NVIDIA chiếm ưu thế tuyệt đối nhờ hệ sinh thái CUDA và thư viện cuDNN tối ưu cho deep learning. PyTorch, TensorFlow, JAX đều hỗ trợ CUDA tốt nhất, giúp cài đặt, tối ưu và vận hành mô hình NLP mượt mà, ít lỗi.

Các GPU AMD hiện tại (hệ sinh thái ROCm) chưa đạt mức ổn định và tương thích như NVIDIA, đặc biệt với các framework AI phổ biến và các mô hình ngôn ngữ lớn.

Phần gợi ý chọn này được viết vào tháng 8/2025 nên thời gian tiếp theo trong tương lai sẽ có những mẫu GPU mới phù hợp hơn.

Việc lựa chọn GPU phù hợp phụ thuộc vào mục tiêu sử dụng, quy mô dự án và ngân sách của bạn. Dưới đây là các khuyến nghị cụ thể cho từng nhóm đối tượng.

|

Model GPU |

VRAM (GB) |

Số lượng Tensor Cores |

Băng thông bộ nhớ (GB/s) |

Giá tham khảo (VNĐ) |

|---|---|---|---|---|

|

NVIDIA RTX 3060 |

12 |

112 |

360 |

7-8 triệu |

|

NVIDIA RTX 4060 Ti |

16 |

136 |

288 |

10-12 triệu |

Nhận xét: RTX 3060 (12GB) là lựa chọn tốt nhất trong tầm giá cho người mới. RTX 4060 Ti (16GB) phù hợp hơn nếu bạn muốn xử lý mô hình lớn hơn hoặc batch size lớn.

|

Model GPU |

VRAM (GB) |

Số lượng Tensor Cores |

Băng thông bộ nhớ (GB/s) |

Giá tham khảo (VNĐ) |

|---|---|---|---|---|

|

NVIDIA RTX 5090 |

36 |

680 |

1.792 |

75-85 triệu |

|

NVIDIA RTX A6000 |

48 |

336 |

768 |

120-150 triệu |

Nhận xét: RTX 5090 là GPU tiêu dùng mạnh nhất, phù hợp cho chuyên gia độc lập, startup. RTX A6000 dành cho doanh nghiệp, phòng lab cần VRAM lớn, driver ổn định, hỗ trợ NVLink.

|

Model GPU |

VRAM (GB) |

Số lượng Tensor Cores |

Băng thông bộ nhớ (GB/s) |

Giá tham khảo (VNĐ) |

|---|---|---|---|---|

|

NVIDIA A100 80GB |

80 |

432 |

2.039 |

>250 triệu |

|

NVIDIA H100 80GB |

80 |

456 |

3.000 |

>350 triệu |

Nhận xét: A100, H100 là tiêu chuẩn vàng cho AI doanh nghiệp, trung tâm dữ liệu, phòng nghiên cứu lớn.

Input và Output của GPU

GPU AMD (ví dụ Radeon Instinct MI200 series) có hiệu năng phần cứng tốt, giá cạnh tranh. Tuy nhiên, hệ sinh thái ROCm chưa hoàn thiện, khó tương thích với các framework AI lớn và các mô hình ngôn ngữ mới nhất. Nếu bạn là nhà phát triển chuyên nghiệp hoặc doanh nghiệp, NVIDIA vẫn là lựa chọn an toàn, hiệu quả và tiết kiệm thời gian hơn.

NVLink là công nghệ kết nối tốc độ cao của NVIDIA, cho phép nhiều GPU giao tiếp trực tiếp với băng thông vượt trội so với PCIe. Với các mô hình quá lớn, NVLink giúp chia VRAM, tăng tốc training và inference hiệu quả.

Lưu ý: NVLink chỉ có trên các dòng GPU cao cấp như RTX A6000, A100, H100. Để tận dụng tối đa, cần hệ thống mainboard và nguồn phù hợp.

Lựa chọn GPU xử lý ngôn ngữ tự nhiên là bước quyết định thành công của mọi dự án NLP, từ học tập đến doanh nghiệp. Hãy ưu tiên VRAM lớn, gắn bó với hệ sinh thái NVIDIA (CUDA), và xác định rõ nhu cầu để chọn GPU phù hợp nhất với ngân sách cũng như mục tiêu phát triển của bạn.

Xem thêm:

Xin cảm ơn bạn đã theo dõi bài viết. Chúc bạn thành công khi lựa chọn GPU phù hợp và hẹn gặp lại trong các bài đánh giá công nghệ tiếp theo!

↑

ĐĂNG NHẬP

Hãy đăng nhập để Chia sẻ bài viết, bình luận, theo dõi các hồ sơ cá nhân và sử dụng dịch vụ nâng cao khác trên trang Game App của

Thế Giới Di Động

Tất cả thông tin người dùng được bảo mật theo quy định của pháp luật Việt Nam. Khi bạn đăng nhập, bạn đồng ý với Các điều khoản sử dụng và Thoả thuận về cung cấp và sử dụng Mạng Xã Hội.