Tại sao cần GPU cho Big Data để tăng tốc xử lý dữ liệu lớn hiệu quả

GPU (Graphics Processing Unit) hay bộ xử lý đồ họa là một loại vi xử lý chuyên biệt, ban đầu được thiết kế để xử lý các tác vụ đồ họa và hình ảnh phức tạp. Điểm nổi bật của GPU là khả năng xử lý song song hàng nghìn phép toán cùng lúc nhờ kiến trúc nhiều nhân xử lý nhỏ, khác biệt hoàn toàn với CPU truyền thống. Chính ưu điểm này giúp GPU ngày càng được ứng dụng rộng rãi trong lĩnh vực Big Data, trí tuệ nhân tạo (AI) và học máy (Machine Learning).

Trong bối cảnh dữ liệu ngày càng lớn và phức tạp, GPU trở thành công cụ đắc lực để rút ngắn thời gian xử lý, tăng hiệu quả phân tích và mở rộng quy mô hệ thống. Các thuật toán phân tích dữ liệu, mô hình học máy hay deep learning đều tận dụng sức mạnh song song của GPU để đạt hiệu suất tối ưu mà CPU khó có thể sánh kịp.

GPU là bộ xử lý chuyên dụng, gồm hàng nghìn nhân nhỏ (cores), mỗi nhân có khả năng thực hiện phép toán đơn giản một cách đồng thời. Nhờ kiến trúc này, GPU cực kỳ phù hợp cho các tác vụ xử lý khối lượng lớn dữ liệu lặp đi lặp lại, như xử lý ma trận, vector – những bài toán thường gặp trong AI, học sâu và Big Data.

Theo NVIDIA, các dòng GPU hiện đại như RTX, Tesla hay A100 đều tích hợp các loại nhân CUDA (Compute Unified Device Architecture) và Tensor Cores, giúp tăng tốc đáng kể các phép toán ma trận, học sâu và phân tích dữ liệu lớn.

Vai trò của GPU trong xử lý Big Data

Big Data là thuật ngữ chỉ khối lượng dữ liệu cực lớn, đa dạng về dạng thức (cấu trúc, phi cấu trúc, bán cấu trúc) và tốc độ sinh ra nhanh chóng. Dữ liệu này đến từ nhiều nguồn như mạng xã hội, thiết bị IoT, cảm biến, giao dịch trực tuyến, video, âm thanh,... Theo IBM, Big Data được định nghĩa bởi 5V:

Big Data đặt ra thách thức lớn cho các hệ thống truyền thống, bởi khối lượng và tốc độ sinh dữ liệu vượt xa khả năng lưu trữ, xử lý, phân tích thông thường. Do đó, việc ứng dụng GPU để tăng tốc phân tích Big Data là xu hướng tất yếu.

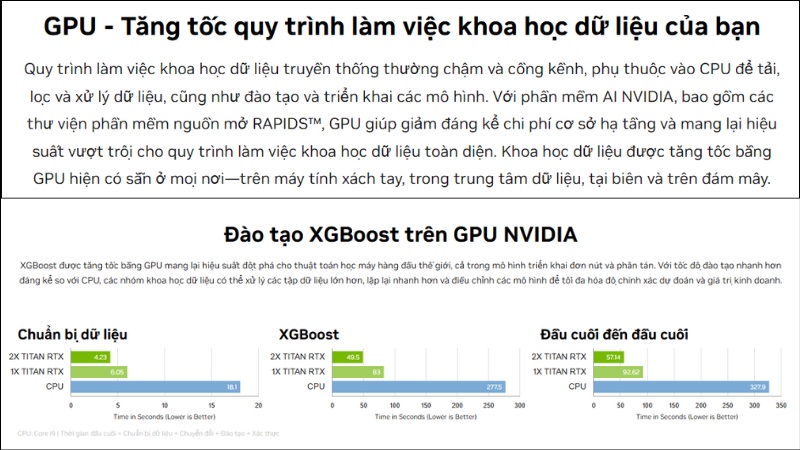

Bạn có thể xem thêm clip sau để hiểu hơn về cách GPU giúp giảm đáng kể chi phí cơ sở hạ tầng và mang lại hiệu suất vượt trội cho quy trình làm việc khoa học dữ liệu toàn diện. Video này được đăng trên trang https://www.nvidia.com/ về chủ đề Deep Learning AI.

CPU (Central Processing Unit) là bộ xử lý trung tâm, sở hữu số lượng nhân xử lý ít (thường 4-64 nhân), tối ưu cho các tác vụ tuần tự, đa nhiệm phức tạp. CPU mạnh về xử lý logic, điều phối luồng dữ liệu và thích hợp cho các tác vụ tổng quát.

Ngược lại, GPU sở hữu hàng nghìn nhân nhỏ, chuyên xử lý đồng thời nhiều phép toán đơn giản, lặp đi lặp lại – rất phù hợp với các tác vụ tính toán song song quy mô lớn như xử lý ma trận, học máy, deep learning hoặc phân tích dữ liệu lớn. Nhờ đó, GPU có thể tăng tốc xử lý lên hàng chục lần so với CPU truyền thống trong các bài toán Big Data.

So với các thế hệ trước, GPU hiện đại tích hợp nhiều nhân hơn, băng thông bộ nhớ lớn hơn và hỗ trợ các công nghệ mới như Tensor Cores, giúp hiệu suất xử lý Big Data ngày càng vượt trội.

|

Tiêu chí |

CPU (Central Processing Unit) |

GPU (Graphics Processing Unit) |

|---|---|---|

|

Số lượng nhân |

4 - 64 |

Hàng nghìn (5120 - 18432+) |

|

Kiến trúc xử lý |

Tuần tự, đa nhiệm |

Song song, đồng thời |

|

Hiệu suất xử lý ma trận |

Trung bình |

Rất cao |

|

Ứng dụng phù hợp |

Điều phối, logic phức tạp |

Học máy, phân tích dữ liệu lớn |

|

Băng thông bộ nhớ |

Thấp - Trung bình |

Cao - Rất cao |

Việc ứng dụng GPU cho Big Data mang lại nhiều lợi ích nổi bật:

Theo NVIDIA và các nghiên cứu của Google Cloud, việc sử dụng GPU trong xử lý Big Data giúp tăng hiệu suất gấp 10-50 lần so với CPU trong các bài toán học sâu, phân tích dữ liệu lớn.

1 hệ thống GPU Server

Nhân GPU (GPU cores) là yếu tố then chốt quyết định sức mạnh xử lý song song. Số lượng nhân càng nhiều, khả năng xử lý đồng thời càng lớn.

Những GPU thế hệ mới như NVIDIA RTX 5090 sở hữu tới 18,432 CUDA Cores, vượt xa các thế hệ trước về khả năng xử lý Big Data.

VRAM là bộ nhớ chuyên dụng của GPU, lưu trữ dữ liệu và mô hình khi xử lý. Dung lượng VRAM lớn giúp GPU xử lý được các tập dữ liệu lớn mà không bị nghẽn bộ nhớ.

Trong thời đại dữ liệu bùng nổ, khối lượng và độ phức tạp của dữ liệu ngày càng tăng. CPU truyền thống khó có thể đáp ứng yêu cầu xử lý nhanh, chính xác và mở rộng quy mô. GPU, với kiến trúc song song và hiệu năng vượt trội, là lựa chọn tối ưu để giải quyết các bài toán Big Data.

Các ứng dụng thực tế sử dụng GPU cho Big Data bao gồm:

Theo báo cáo của NVIDIA và Google Cloud, các tổ chức ứng dụng GPU vào phân tích dữ liệu lớn đã rút ngắn thời gian xử lý từ hàng ngày xuống chỉ còn vài giờ hoặc phút, đồng thời tiết kiệm chi phí vận hành đáng kể.

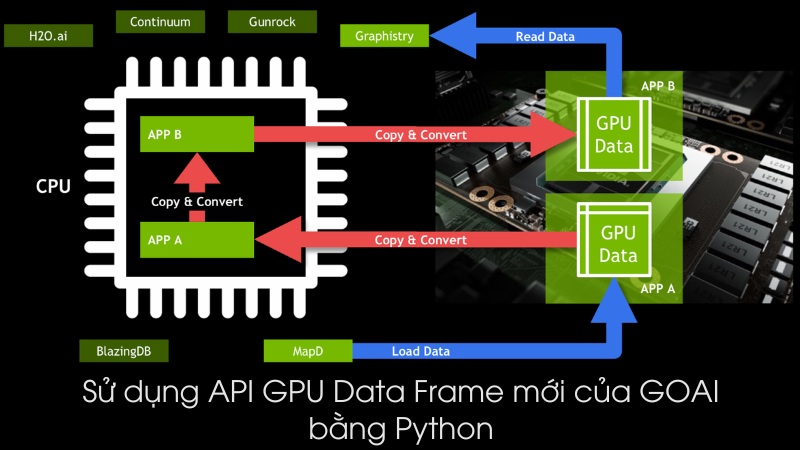

Ví dụ API GPU

Phần gợi ý chọn này được viết vào tháng 8/2025 nên thời gian tiếp theo trong tương lai sẽ có những mẫu GPU mới phù hợp hơn.

Dưới đây là bảng so sánh các mẫu GPU nổi bật, phù hợp cho xử lý Big Data và AI hiện nay, cập nhật dựa trên thông số chính thức từ NVIDIA và AMD:

| Model GPU | Nhân CUDA / Stream Processors | VRAM | Đặc điểm nổi bật | Phù hợp cho |

|---|---|---|---|---|

| NVIDIA RTX 5090 | 18,432 CUDA Cores | 24 GB GDDR6X | Tensor Cores thế hệ mới, băng thông cực cao | AI/ML, xử lý dữ liệu lớn |

| NVIDIA A100 Tensor Core | 6,912 CUDA + Tensor Cores | 40/80 GB HBM2 | GPU trung tâm dữ liệu, tối ưu Deep Learning, HPC | Big Data & AI quy mô lớn |

| AMD Radeon RX 7900 XTX | 6,144 Stream Processors | 24 GB GDDR6 | Băng thông cao, hiệu năng mạnh | Big Data, máy học |

| NVIDIA Quadro RTX 6000 | 4,608 CUDA Cores | 24 GB GDDR6 | Tối ưu workstation, xử lý tính toán chuyên sâu | Phân tích dữ liệu, Big Data |

Xem thêm:

Laptop hoàn toàn có thể xử lý Big Data nhưng với những giới hạn nhất định về phần cứng so với máy chủ (server) hoặc workstation chuyên dụng.

Một số mẫu laptop chuyên dụng có GPU mạnh, phù hợp cho xử lý Big Data cá nhân có tại Thế Giới Di Động (cập nhật 2025):

| Model Laptop | GPU tích hợp | VRAM | Đặc điểm nổi bật | Phù hợp cho |

|---|---|---|---|---|

| MSI Vector 16 HX AI (010VN_32GB) | NVIDIA GeForce RTX 5070Ti | 12 GB | CPU Ultra 7, 32GB RAM, màn hình 240Hz | Bắt đầu với Big Data, xử lý các dataset kích thước vừa, huấn luyện các mô hình AI/ML không quá phức tạp. |

| MSI Vector 16 HX AI (062VN) | NVIDIA GeForce RTX 5080 | 16 GB | CPU Ultra 9 mạnh mẽ, màn hình 240Hz | Phân tích và xử lý các bộ dữ liệu lớn, tăng tốc các tác vụ tính toán song song trên GPU. |

| Lenovo Legion Pro 7 16IAX10H | NVIDIA GeForce RTX 5080 | 16 GB | Màn hình OLED, vỏ kim loại cao cấp, nhẹ (2.57kg) | Lựa chọn tốt cho các nhà khoa học dữ liệu, xử lý các bộ dữ liệu lớn và huấn luyện các mô hình AI phức tạp. |

| Acer Predator Helios 18 AI (93P0) | NVIDIA GeForce RTX 5080 | 16 GB | Màn hình lớn 18" 250Hz, 64GB RAM | Rất phù hợp để tiền xử lý và phân tích các tập dữ liệu rất lớn nhờ có 64GB RAM, cũng như huấn luyện các mô hình AI đòi hỏi nhiều VRAM. |

| Acer Predator Helios 18 AI (98AQ) | NVIDIA GeForce RTX 5090 | 24 GB | Cấu hình cực khủng (192GB RAM, 6TB SSD), màn hình 4K | Xử lý các tác vụ Big Data và huấn luyện các mô hình Deep Learning cực lớn, tương đương một máy trạm di động (mobile workstation). |

Xem thêm:

GPU là chìa khóa tăng tốc xử lý Big Data hiện đại, giúp doanh nghiệp, cá nhân tối ưu phân tích dữ liệu lớn hiệu quả. Laptop có thể làm Big Data nhưng nên kết hợp hệ thống mạnh để đạt hiệu suất tối ưu. Cảm ơn bạn đã theo dõi, hẹn gặp lại trong các bài đánh giá công nghệ tiếp theo!

↑

ĐĂNG NHẬP

Hãy đăng nhập để Chia sẻ bài viết, bình luận, theo dõi các hồ sơ cá nhân và sử dụng dịch vụ nâng cao khác trên trang Game App của

Thế Giới Di Động

Tất cả thông tin người dùng được bảo mật theo quy định của pháp luật Việt Nam. Khi bạn đăng nhập, bạn đồng ý với Các điều khoản sử dụng và Thoả thuận về cung cấp và sử dụng Mạng Xã Hội.